安卓也能玩原生龙虾了!可发语音、可发图,微信接入OpenClaw全网唯一教程

大家好,我是二哥呀。

大号【沉默王二】发了一篇 iPhone 手机接入微信 OpenClaw 的教程,有小伙伴按照教程已经安装成功了。

然后就有小伙伴私信说安卓手机可不可以?

答案是可以!

不仅可以发语音,还可以发图,并且微信也不用升级到最新版。我这边是 8.0.69 版本,小米 17 Pro Max。

上一篇 iPhone 教程出来之后,安卓用户急了。评论区一片“安卓什么时候能用?”“8.0.69 行不行?”“不是最新版也可以吗?”私信更是没断过,有个小伙伴连续三天问我同一个问题。

说真的,安卓用户的焦虑我理解。毕竟国内安卓用户才是大多数,iPhone 先行一步,安卓这边干着急没办法,那感觉就像食堂排队,前面的人都打完饭了,你还没轮到。

今天这篇,就是给安卓用户的专属教程。不仅教你怎么接入,还会把 iPhone 版没有展示的能力——语音交互、图片识别、表情包搜索——全部实测给你看。安卓用户这次不仅没落下,体验上可能还更完整。

01、安装前准备

先说一下前置条件。你的电脑上需要有 Node.js 环境,版本 18 以上就行。如果你之前跟着 iPhone 教程已经装过一次,那环境已经有了,直接跳到下一步。

如果你是第一次折腾,去 Node.js 官网下载一个 LTS 版本装上就行,Windows、macOS 都有安装包,双击一路下一步。装完之后在终端输入 node -v,能看到版本号就说明装好了。

安卓手机这边没什么特殊要求,微信版本不需要最新的。我用的是 8.0.69 版本,完全没问题。这一点比 iPhone 版友好太多了,iPhone 那边要求 8.0.70,很多人升级不了还得等灰度。

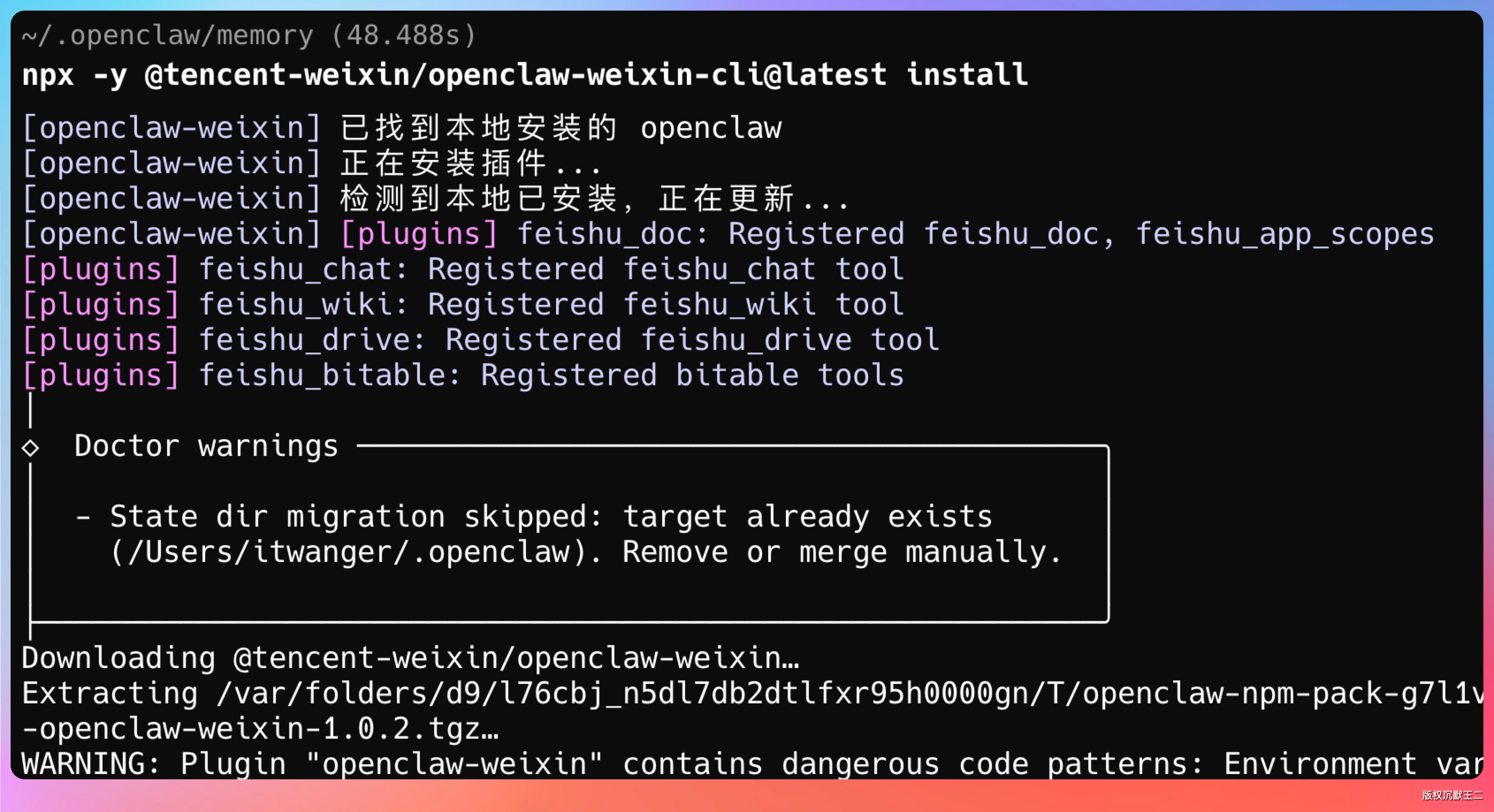

02、安装微信OpenClaw插件

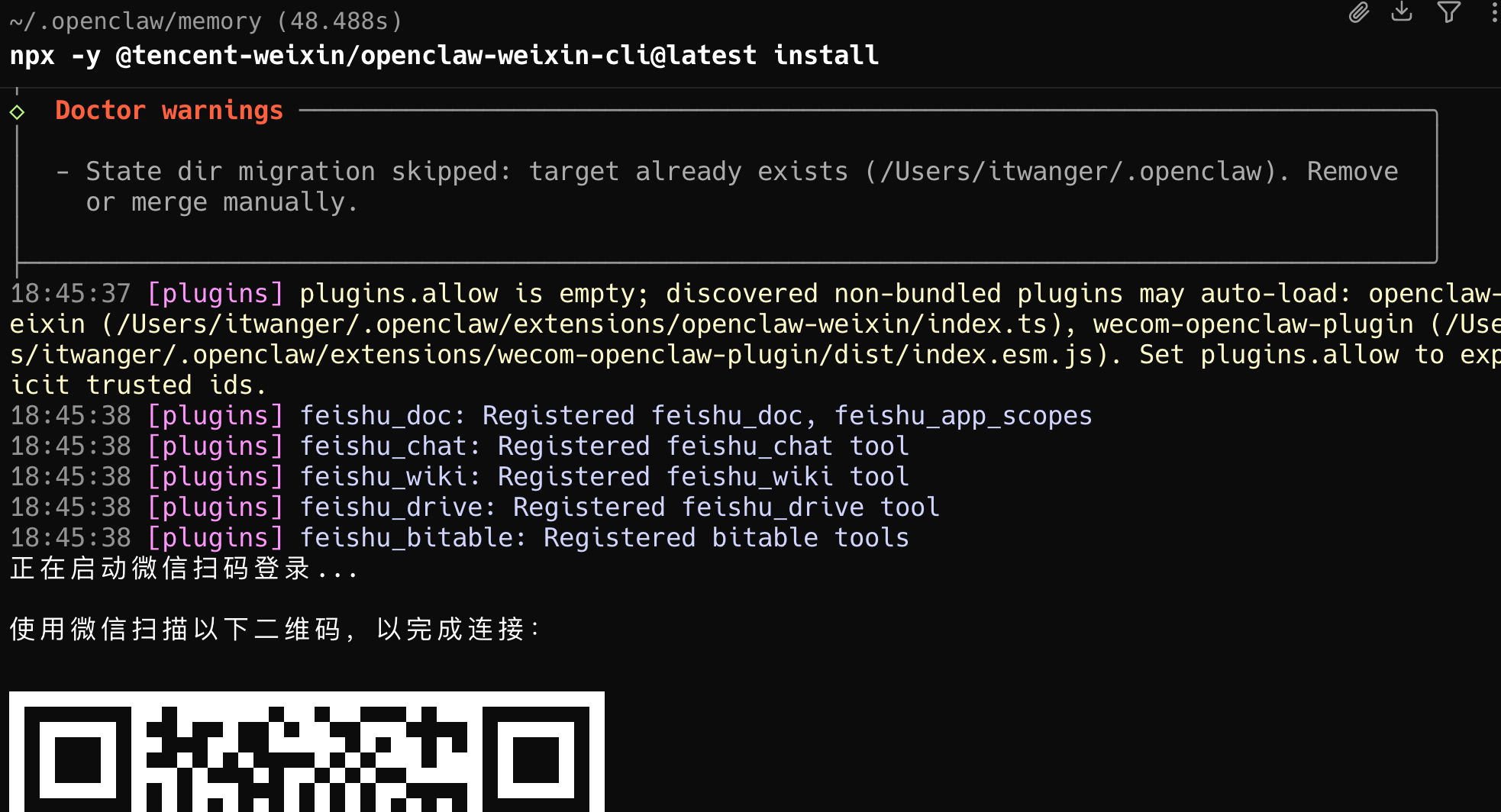

环境准备好之后,打开电脑的终端(Windows 用 PowerShell 或者 CMD 都行,Mac 用终端),执行这一行命令:

npx -y @tencent-weixin/openclaw-weixin-cli@latest install

如果你之前已经在 iPhone 上安装过,这次执行后,插件会提示我们已经安装了 OpenClaw,本地也已经安装了 openclaw-weixin 插件,正在升级。

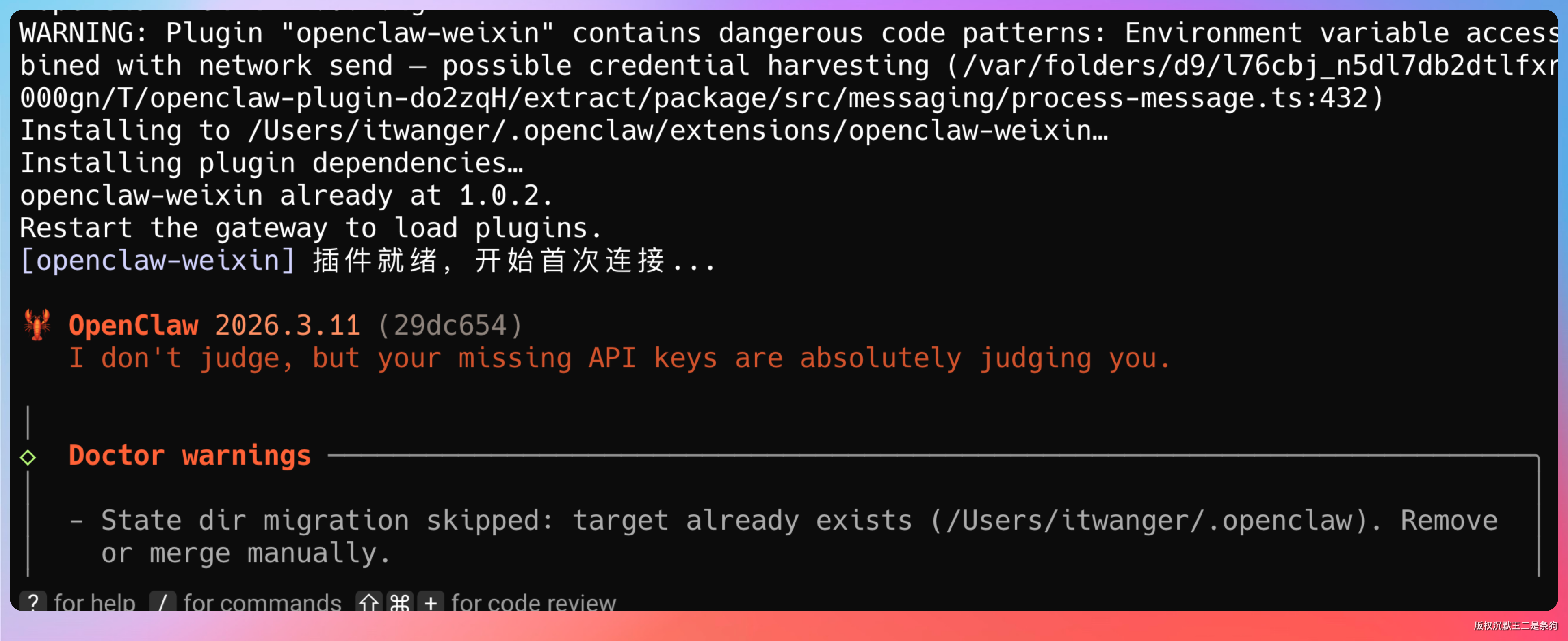

然后下载、解压、安装,最新版是 1.0.2。整个过程大概一两分钟,取决于网络速度。

安装完成后提示插件已就绪,开始首次连接。

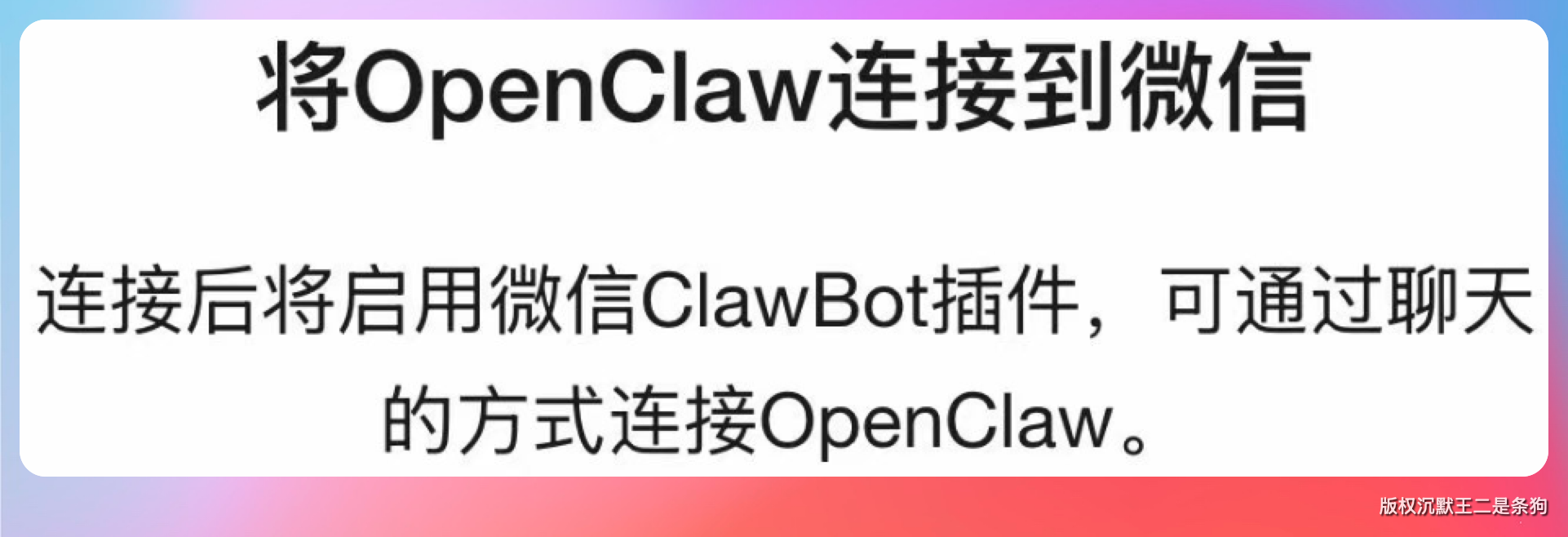

接着就会出现微信扫码界面。拿起我们的安卓手机,打开微信直接扫码就可以了。这里注意一下,扫码用微信自带的扫一扫就行,不需要用相机。

手机侧的提醒如下所示:

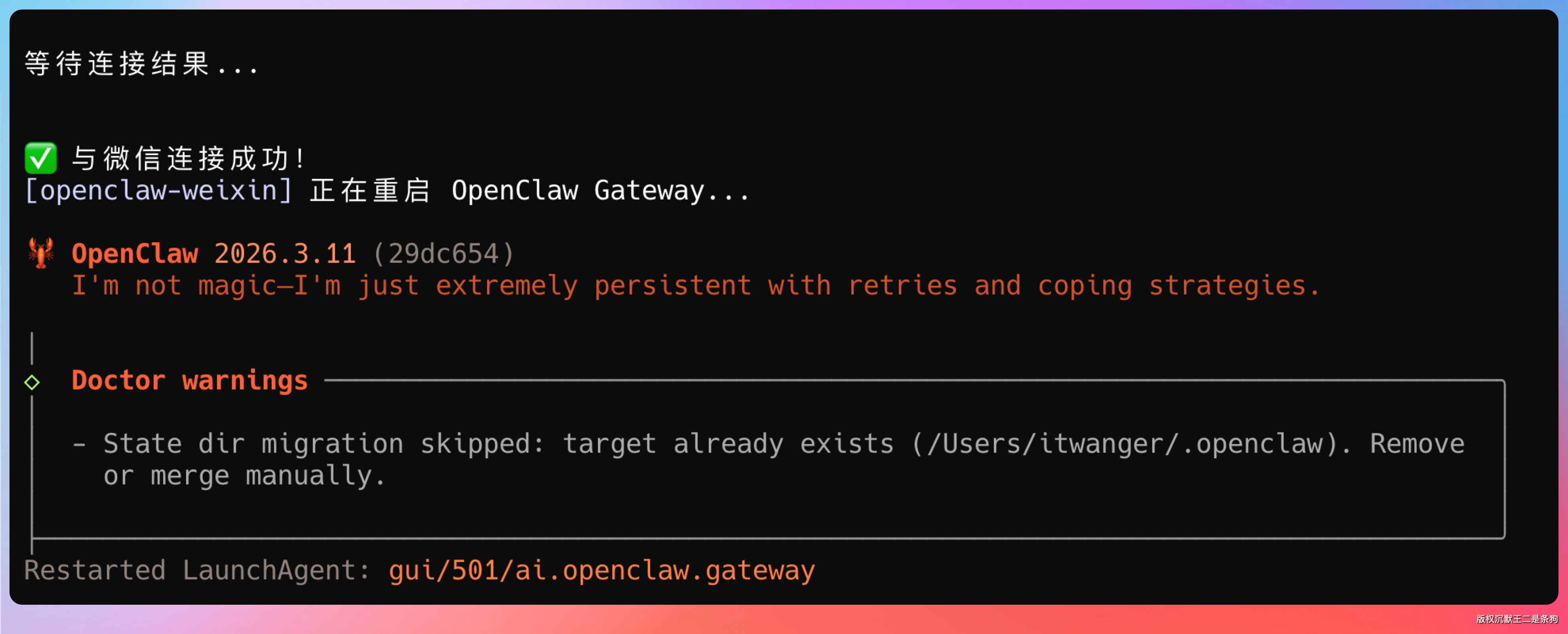

点击确认之后,手机和电脑就建立了连接。控制台会提示“与微信连接成功!正在重启 OpenClaw Gateway。”

到这一步,安装就完成了。和 iPhone 版的安装流程完全一样,一行命令 + 扫码,安卓不需要额外的配置。整个过程从执行命令到连接成功,非常顺利的话两分钟搞定。

有一个小细节提醒一下:安装完成后,电脑端的终端窗口不要关。龙虾是通过这个进程和微信保持连接的,关了终端,连接就断了。如果你想让它一直在线,可以把终端最小化放到后台。

03、测试消息收发

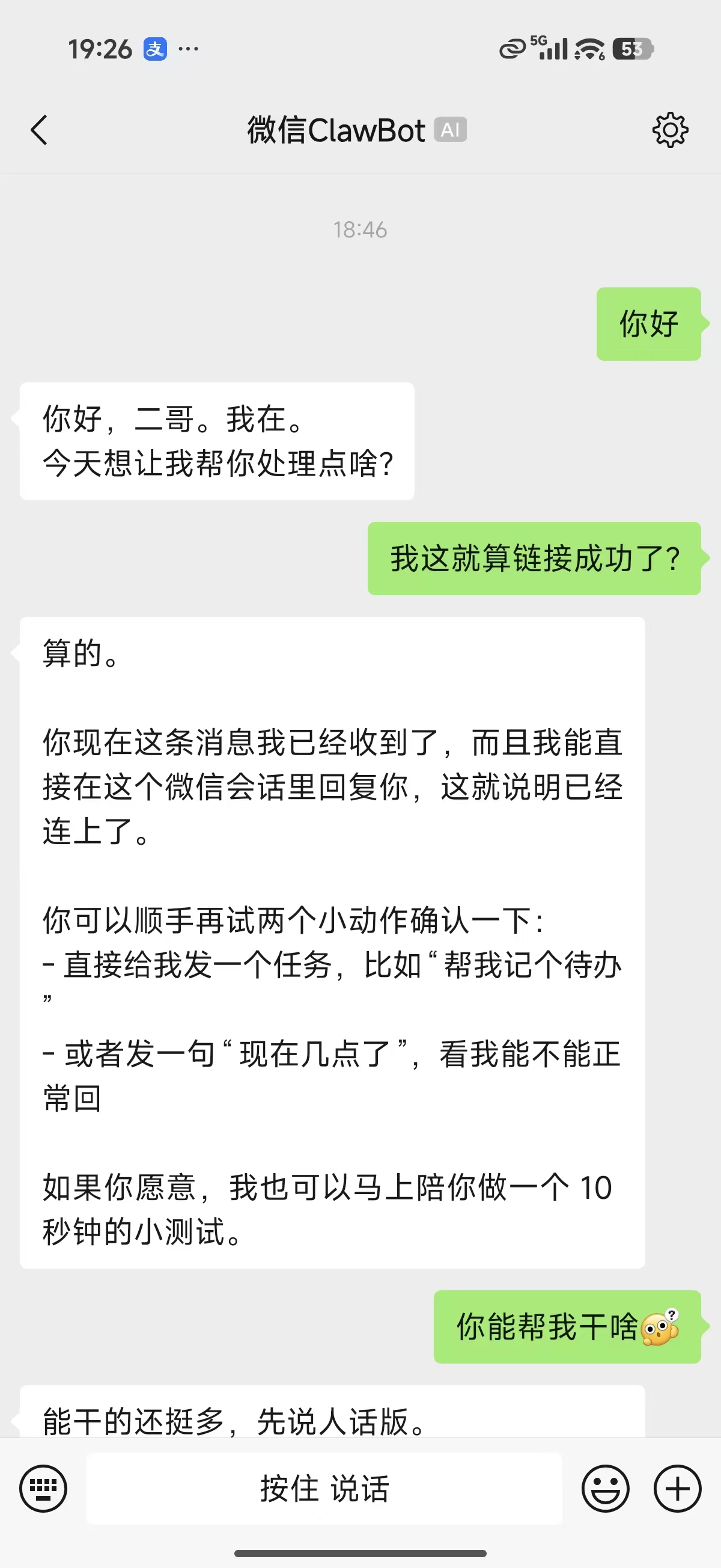

安装完成后,第一件事当然是测试一下消息能不能正常收发。

随便发个消息过去,如果能收到回复,就表示我们的微信和龙虾之间的连接成功了。

收到回复了,连接成功。回复速度也挺快的,基本上发出去几秒钟就有回应。

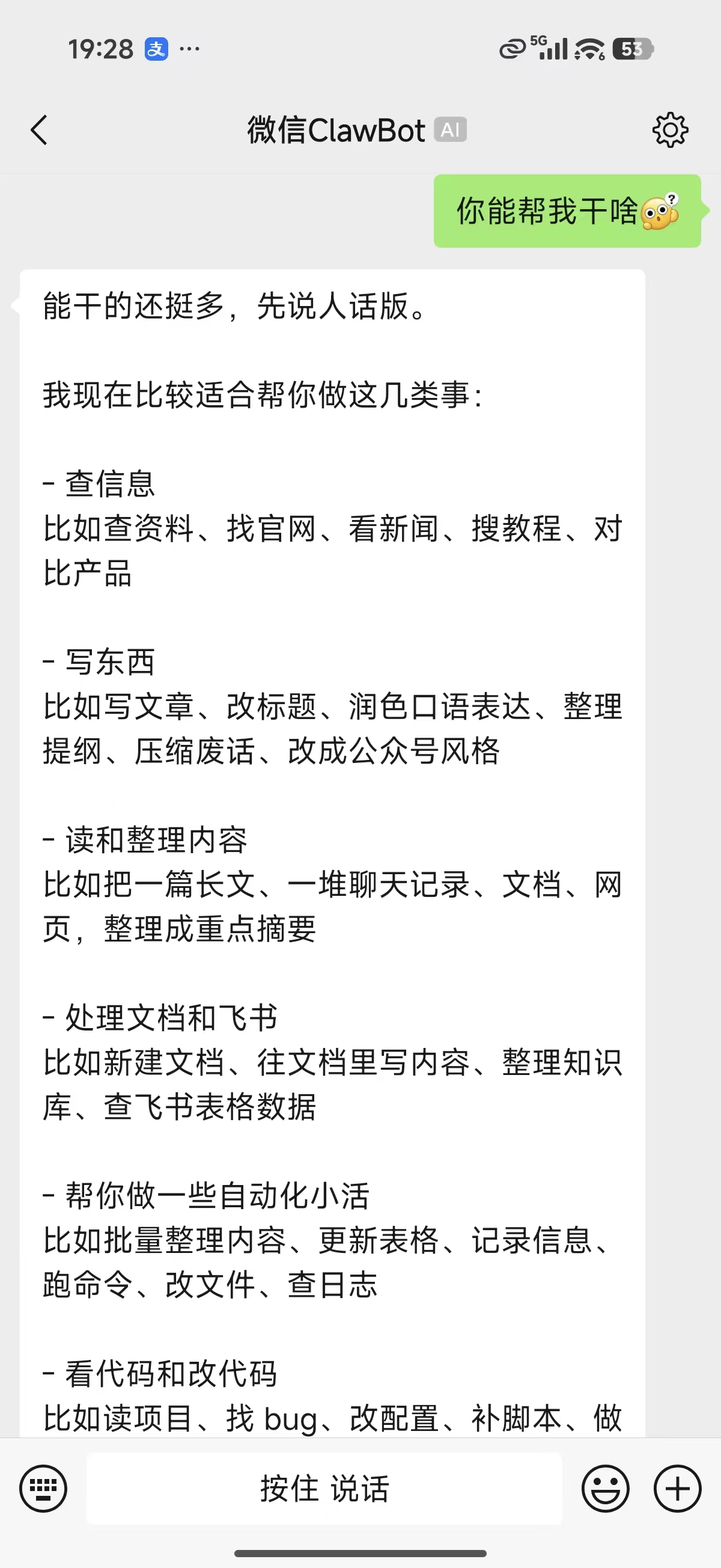

接下来问问它能帮我们干啥?

能干的还挺多:

- 查信息:查资料、找官网、看新闻、搜教程、对比产品

- 写东西:写文章、改标题、润色口语表达、整理提纲、压缩废话、改成公众号风格

- 读和整理内容:把一篇长文、一堆聊天记录、文档、网页,整理成重点摘要

- 处理文档和飞书:新建文档、往文档里写内容、整理知识库、查飞书表格数据

- 自动化小活:批量整理内容、更新表格、记录信息、跑命令、改文件、查日志

- 看代码和改代码:读项目、找 bug、改配置、补脚本、做小功能

- 操作网页:打开网页、点按钮、填表单、截图、提取页面内容

- 记事情:帮你记住偏好和决定,下次接着用

- 日常小事:帮想回复、改措辞、总结今天做了什么

说真的,看到这个列表我有点激动。这以后可太方便了,要知道,我平常的主要交流就是在微信上,4 万多好友,几十个活跃群。如果龙虾能帮我处理一部分消息,每天至少能省出一两个小时。

以前有小伙伴问我技术问题,我经常因为忙顾不上。现在好了,龙虾可以先帮我回答一些常见问题,我有空的时候再看看有没有遗漏的。以后大家就可以找我痛快私聊,我可以无限回答。

我还试了几个具体场景。比如让它帮我写一段公众号的开头,它给出的版本还挺接地气的,稍微改改就能用。再比如让它帮我查一下最近 Spring Boot 3.4 的新特性,它能把关键变化整理成几条,比我自己翻文档快多了。

04、/命令和链接解析

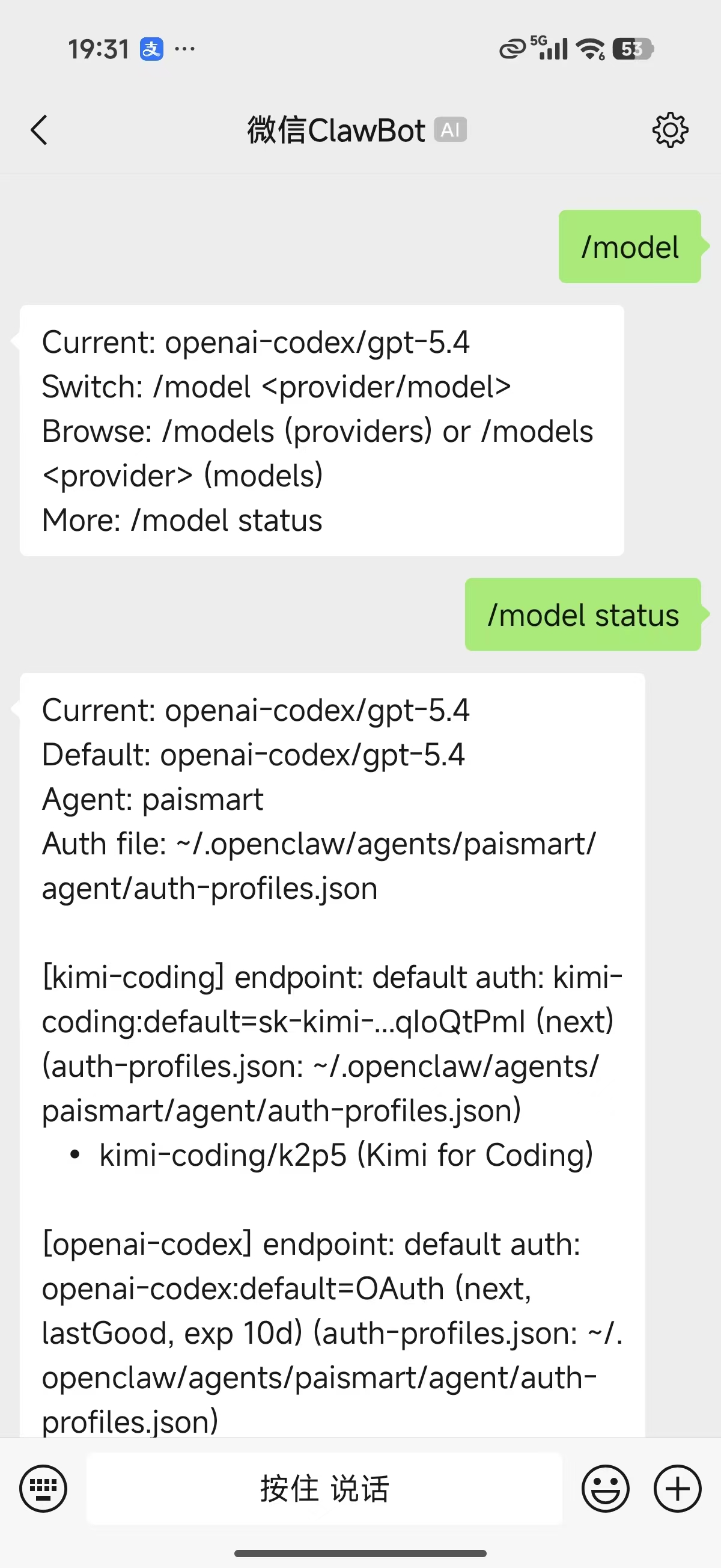

安卓版还支持 /命令,这个功能非常实用。

比如说我们输入 /model gpt,就可以切换到 GPT-5.4 模型了。这意味着你可以在微信里直接切换大模型,不需要回到电脑端改配置。想用 DeepSeek 的时候 /model deepseek,想用 GLM 的时候 /model glm,一条消息搞定。

这个设计非常聪明。不同的模型擅长的领域不一样,DeepSeek 写代码很强,GLM 做工程理解很到位,Kimi 处理长文档有优势。有了 /model 命令,你可以根据当前的需求随时切换,就像手机里装了好几个 App,但你只需要在一个聊天窗口里操作。

我测试了一下切换速度,基本上发完命令几秒钟就切好了,下一条消息就是新模型在回复。这个体验比在网页端来回切换标签页舒服太多了。

除了 /model,还有其他命令可以用。比如 /help 可以查看所有支持的命令,/clear 可以清除上下文重新开始对话。这些命令让你在微信里就能完成大部分控制操作,不需要回到电脑端。

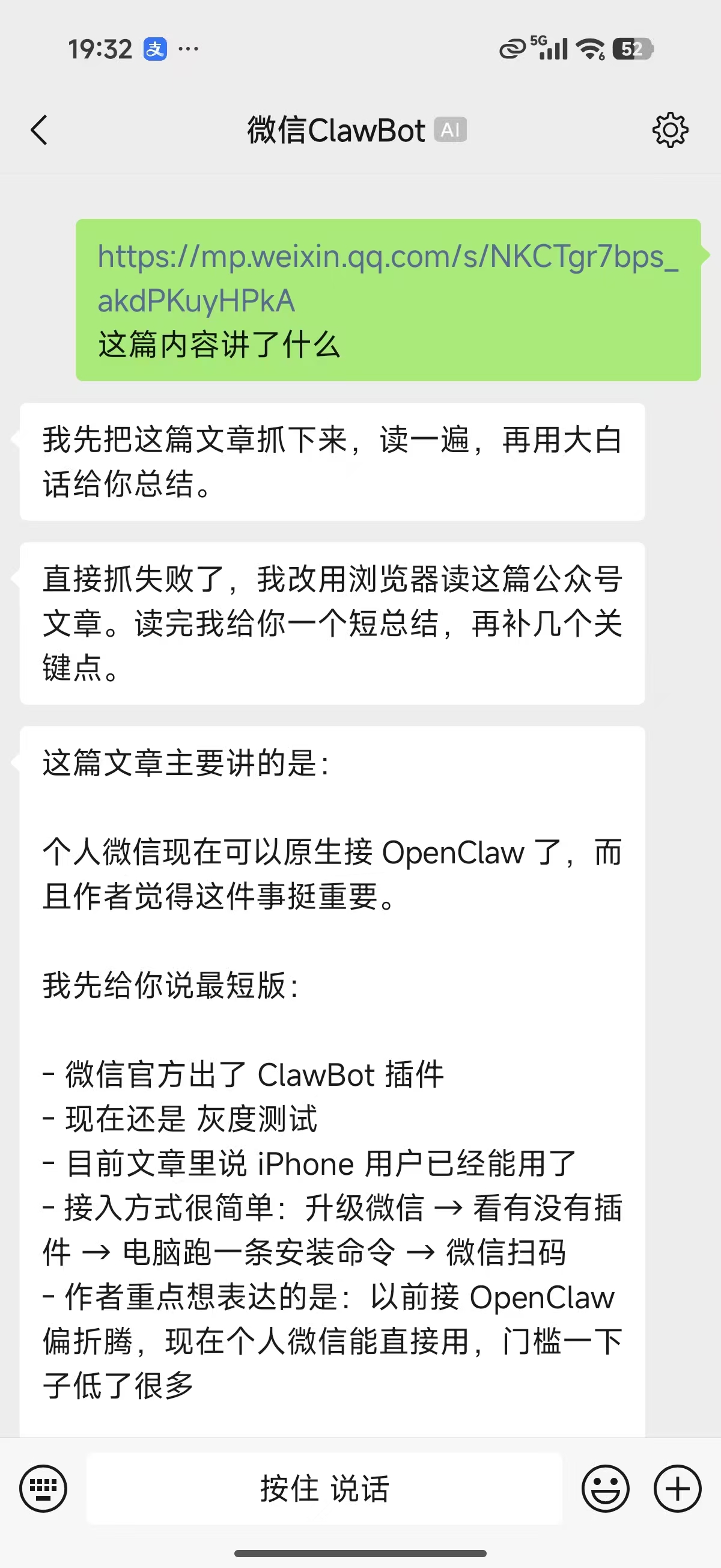

除了切换模型,龙虾还能解析链接。你把一个网页地址发过去,它会帮你读取网页内容,然后整理出来。

比如说我把大号发的 OpenClaw 接微信的教程链接丢过去,龙虾能帮我直接整理出来重点内容:

作者想表达的是:AI 助手以后不一定是一个单独 App,而是直接住进微信聊天框里。

核心观点压成一句话:微信原生接入 OpenClaw,把 AI Agent 的使用门槛拉低了。

作者兴奋的原因:接入更简单、场景更贴近日常聊天。

隐藏重点:AI Agent 真正普及,不靠大家学一堆配置,而是靠它悄悄进到大家本来就在用的地方。而微信,就是那个最现实的入口。

总结得比我自己写的还精炼。

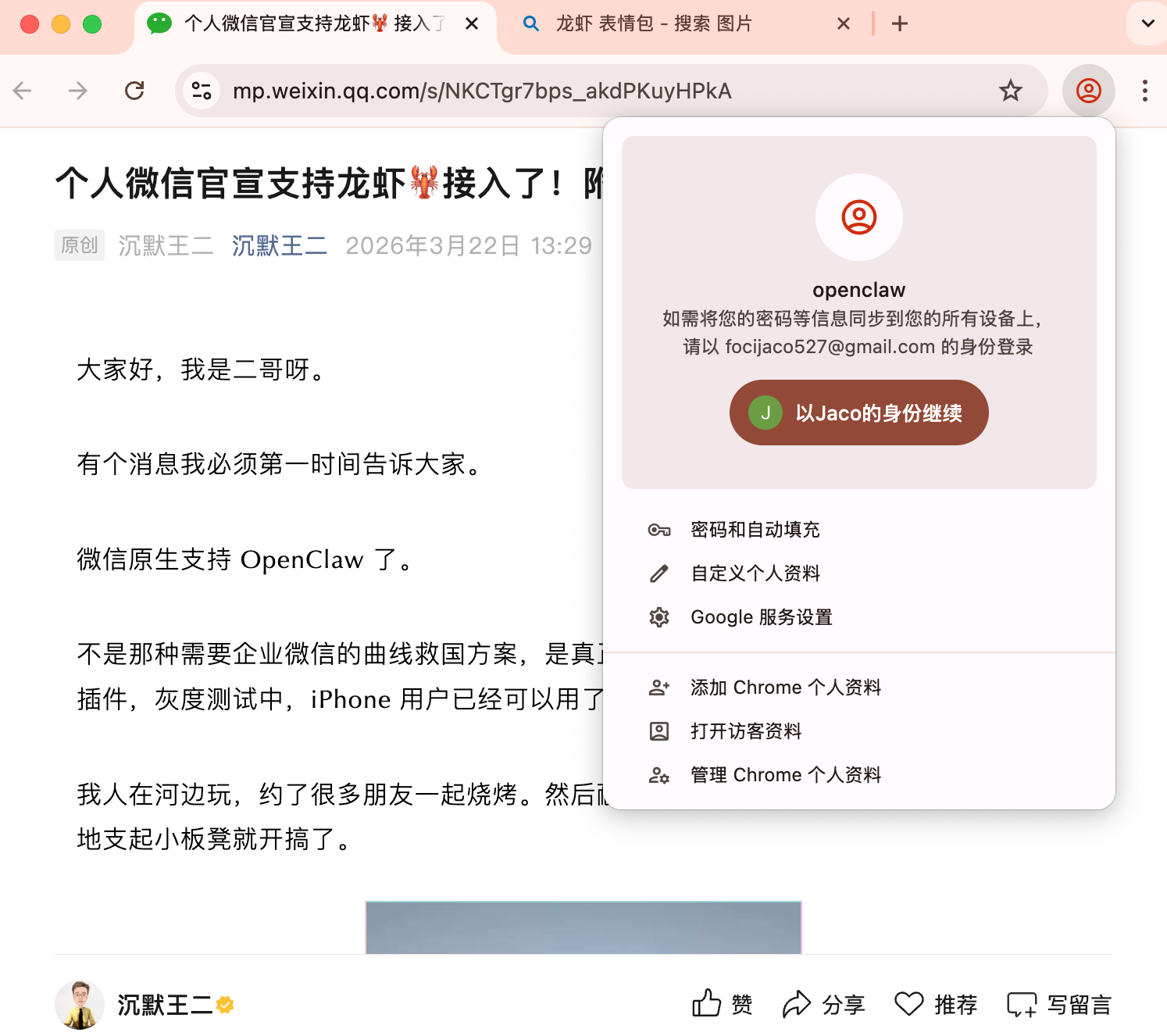

OpenClaw 这边是通过 Chrome 浏览器打开网页读取内容的。

注意看右侧这里,提示的是“OpenClaw 用户在控制”。也就是说,龙虾在你的电脑上打开了一个浏览器窗口,帮你把网页内容读取出来,然后分析整理好发到微信里。整个过程你能在电脑上看到浏览器的操作,完全透明。

这个能力日常使用频率会非常高。以后看到一篇长文章,不想花时间读?直接把链接丢给龙虾,让它帮你总结要点。看到一个技术文档太长不想翻?丢链接过去,让它帮你提取关键信息。甚至你在群里看到别人分享了一篇文章,来不及看,转发给龙虾,晚上回家的时候看它整理好的摘要就行了。

省下来的时间,可以多烤两串羊肉串。

05、图片识别能力

这一点是安卓版比 iPhone 版更强的地方——安卓版支持直接发图片给龙虾,龙虾能识别图片中的内容。

我把修改简历的截图发过去,它能读出来有哪些大学,包括:

- 中国石油大学:211

- 北京邮电大学本硕:211

- 安徽大学:211

- 南京理工大学本硕:211

- 重庆大学 / 四川农业大学:985/211

- 浙江科技大学本硕:双非本

- 中南大学 / 莫斯科国立大学:海外硕/985

- 华南理工大学 / 中国地质大学:985/211

识别得非常准确,连学校的层次都标注出来了。要知道这张截图上的文字还挺小的,龙虾照样看得清清楚楚。

这个图片识别能力,想象空间太大了。我随便举几个场景你就明白了。

出差的时候拍个英文菜单发过去,龙虾帮你翻译,再也不用对着菜单猜半天。开发的时候遇到报错,截图发过去,龙虾帮你分析错误原因,比你自己搜 Stack Overflow 快多了。产品经理给你一张手绘的原型图,拍照发给龙虾,它能帮你把需求整理成文字版。

还有一个很实用的场景:收到纸质文件或者合同,拍个照发给龙虾,它能帮你把关键条款提取出来。以前这种事情要么找 OCR 工具,要么自己一个字一个字敲。现在拍个照,一条消息搞定。

以后出门遇到不认识的东西,拍个照发给龙虾就行了。不管是路边的植物、菜场的鱼、还是药盒上的英文说明,它都能帮你识别。

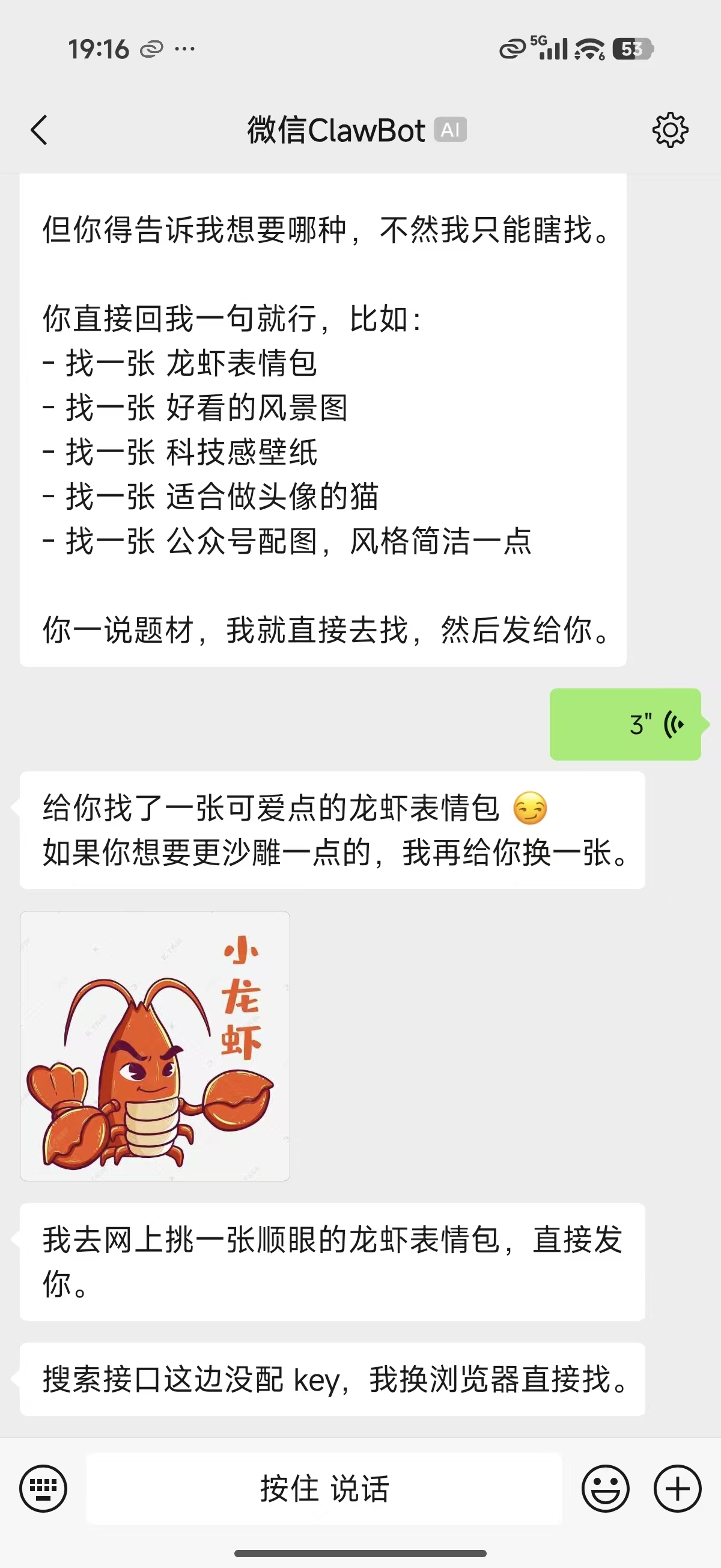

06、语音交互和表情包

安卓版还支持发表情、发语音,这是我测下来最惊喜的部分。

虽然暂时还没有语音回复我,但我后面可以给 OpenClaw 加 TTS,让它直接语音回复我就好了。也可以直接给它接入图片生成。大家可以期待下。

我觉得目前最爽的,就是我可以直接发语音控制 OpenClaw。按住说话就行,跟平时和朋友聊天一模一样的操作。

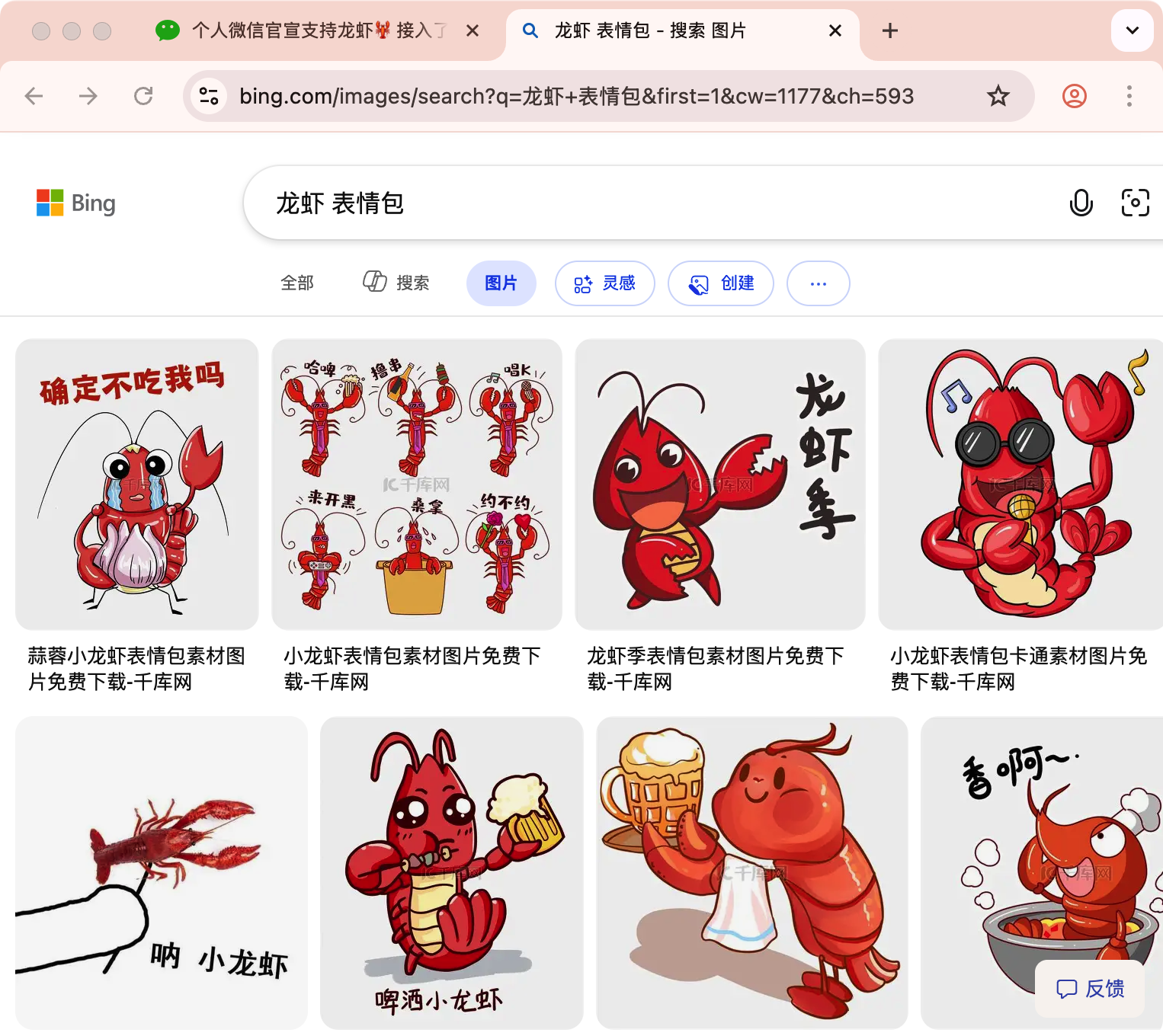

比如说我语音让它帮我找一张小龙虾的表情包。

OpenClaw 会打开浏览器找到表情包,然后直接发到微信里来。

你品品这个交互流程:

- 拿起手机,按住说话:“帮我找一张小龙虾的表情包”

- 松手,等几秒

- 表情包就到了

全程不用打字,不用切换 App,不用打开浏览器搜索,不用保存图片再转发。一条语音,搞定。

这才是 AI 助手该有的样子——不是让你学一堆操作,而是你怎么方便怎么来。

想想平时用 AI 工具的流程:打开浏览器,输入网址,登录账号,输入提示词,等待回复,复制结果,粘贴到需要的地方。步骤太多了。现在呢?微信里按住说话,结果直接在聊天窗口里出来。

语音交互的另一个好处是解放双手。比如你在做饭的时候突然想查个食谱,手上沾着面粉没法打字,按住说话就行了。再比如你在开车(当然要安全第一),想让龙虾帮你查个地址、整理个信息,语音发过去就行。

07、安卓 vs iPhone 对比

跑完整个流程,我来做个简单对比:

| 维度 | iPhone版 | 安卓版 |

|---|---|---|

| 微信版本要求 | 8.0.70(需最新版) | 8.0.69(不需最新版) |

| 安装方式 | 一行命令 + 扫码 | 一行命令 + 扫码 |

| 文本消息 | ✅ | ✅ |

| 图片识别 | ⚠️ 未确认 | ✅ 支持 |

| 语音交互 | ⚠️ 未确认 | ✅ 支持 |

| 链接解析 | ✅ | ✅ |

| /命令 | ✅ | ✅ |

| 表情包 | ⚠️ 未确认 | ✅ 支持 |

安卓版在图片识别、语音交互、表情包这几个维度上是确认可用的,iPhone 版我在上一篇教程里没有充分测试这几项,后续补上。

但就目前的测试来看,安卓版的多媒体能力是明确可用的。而且安卓版的微信版本要求更低,8.0.69 就能用,不需要像 iPhone 那样等最新版的灰度推送。这对安卓用户来说是个好消息——你大概率现在就能用,不需要等任何更新。

从体验角度来说,安卓和 iPhone 的文本交互没有区别,回复速度、内容质量都是一样的,因为背后跑的是同一个 OpenClaw 服务。差异主要在多媒体能力上,安卓这边目前展示出了更完整的支持。

08、接下来可以做什么

接入成功只是第一步,接下来你可以玩出更多花样。

给龙虾配不同的模型

通过 /model 命令随时切换:DeepSeek 写代码、GLM 做工程、Kimi 做前端、Doubao 做日常。一个微信窗口,多个大脑随时切换。你甚至可以针对不同的聊天场景设定不同的模型偏好。比如有人问你代码问题,切到 DeepSeek;有人让你帮忙写文案,切到 GLM。

给龙虾装 Skills

OpenClaw 支持 Skills 扩展。你可以给龙虾装上“周报生成器”“简历优化器”“翻译助手”等技能,让它在不同场景下发挥不同的作用。Skills 就像是给龙虾加 buff,装得越多,能干的事情越多。

给龙虾接入 TTS

目前龙虾还不能语音回复,但你可以自己配一个 TTS 服务,让龙虾用语音回你。想象一下,你发语音过去,龙虾语音回你,就像真人对话一样。这个配好之后,整个交互体验会再上一个台阶。

给龙虾接入图片生成

配上 DALL-E 或者 Midjourney 的 API,龙虾就能帮你画图了。发一条消息“画一只穿西装的小龙虾”,几秒钟后图片就到微信里了。做公众号的话这个功能特别实用,封面图、配图、表情包都可以让龙虾帮你生成,省下不少设计费。

不敢想,如果微信能够把全能力都接入到 OpenClaw,可以做的事情就太多了。

ending

对于我这种微信高需求量的用户,这种原生接入的方式,真的太爽了。

4 万多好友,几十个活跃群,每天微信里的信息量巨大。以前处理这些信息,全靠人肉翻聊天记录、手动查资料、一条条回消息。现在有了龙虾,至少有一半的重复性工作可以交给它。

帮我总结群聊要点、帮我回复常见问题、帮我查资料、帮我整理文档。这些事情以前每天要花我两三个小时处理,现在丢给龙虾,我只需要花几分钟确认一下结果就行了。

更重要的是,安卓用户不需要等最新版微信。8.0.69 就能用,不需要灰度,不需要等待。一行命令,扫码连接,马上就能玩起来。

语音、图片、链接、表情包,全部支持。

我以前一直觉得,AI 工具和普通人之间隔着一道门槛。你得会翻墙,得会注册海外账号,得会写提示词,得会折腾各种配置。大部分人在第一步就放弃了。

但微信不一样。微信是所有人都会用的东西,你教你妈发微信消息她会,你教她用 ChatGPT 她不会。当 AI 住进微信里,这道门槛就彻底消失了。

这还只是开始。

【AI Agent 真正普及,不靠大家学一堆配置,而是靠它悄悄进到大家本来就在用的地方。微信,就是那个最现实的入口。】

如果你是安卓用户,赶紧试试。

有问题评论区见,我们下期见!